Zuletzt aktualisiert am 5. Juli 2019

Bei der Gesichtserkennung handelt es sich um das Problem, Personen auf einem Foto anhand ihres Gesichts zu identifizieren und zu überprüfen.

Es ist eine Aufgabe, die von Menschen trivial ausgeführt wird, selbst unter wechselndem Licht und wenn Gesichter nach Alter verändert oder mit Accessoires und Gesichtsbehaarung verdeckt werden. Dennoch ist es seit Jahrzehnten bis vor kurzem ein herausforderndes Computer-Vision-Problem geblieben.Deep-Learning-Methoden sind in der Lage, sehr große Datensätze von Gesichtern zu nutzen und reichhaltige und kompakte Darstellungen von Gesichtern zu lernen, so dass moderne Modelle zuerst die gleiche Leistung erbringen und später die Gesichtserkennungsfähigkeiten von Menschen übertreffen können.

In diesem Beitrag werden Sie das Problem der Gesichtserkennung entdecken und wie Deep-Learning-Methoden übermenschliche Leistung erzielen können.

Nachdem Sie diesen Beitrag gelesen haben, werden Sie wissen:

- Die Gesichtserkennung ist ein weit gefasstes Problem bei der Identifizierung oder Überprüfung von Personen in Fotos und Videos.

- Gesichtserkennung ist ein Prozess, der aus Erkennung, Ausrichtung, Merkmalsextraktion und einer Erkennungsaufgabe besteht

- Deep-Learning-Modelle näherten sich zuerst der menschlichen Leistung für Gesichtserkennungsaufgaben und übertrafen sie dann.

Starten Sie Ihr Projekt mit meinem neuen Buch Deep Learning for Computer Vision, das Schritt-für-Schritt-Anleitungen und die Python-Quellcodedateien für alle Beispiele enthält.

Los geht’s.

Eine sanfte Einführung in Deep Learning zur Gesichtserkennung

Foto von Susanne Nilsson, einige Rechte vorbehalten.

- Übersicht

- Gesichter in Fotografien

- Möchten Sie Ergebnisse mit Deep Learning für Computer Vision?

- Prozess der automatischen Gesichtserkennung

- Gesichtserkennungsaufgabe

- Gesichtserkennungsaufgaben

- Deep Learning für die Gesichtserkennung

- Weiterführende Literatur

- Bücher

- Papiere zur Gesichtserkennung

- Deep Learning Face Recognition Papers

- Artikel

- Zusammenfassung

- Entwickeln Sie noch heute Deep-Learning-Modelle für die Vision!

- Entwickeln Sie Ihre eigenen Vision-Modelle in Minuten

- Bringen Sie endlich Deep Learning in Ihre Vision-Projekte

Übersicht

Dieses Tutorial ist in fünf Teile gegliedert; sie sind:

- Gesichter in Fotografien

- Prozess der automatischen Gesichtserkennung

- Gesichtserkennungsaufgabe

- Gesichtserkennungsaufgaben

- Deep Learning für die Gesichtserkennung

Gesichter in Fotografien

Es besteht oft die Notwendigkeit, die Personen auf einem Foto automatisch zu erkennen.

Es gibt viele Gründe, warum wir eine Person auf einem Foto automatisch erkennen möchten.

Beispiel:

- Möglicherweise möchten wir den Zugriff auf eine Ressource auf eine Person beschränken, die als Gesichtsauthentifizierung bezeichnet wird.

- Möglicherweise möchten wir bestätigen, dass die Person mit ihrer ID übereinstimmt, was als Gesichtsüberprüfung bezeichnet wird.

- Möglicherweise möchten wir einem Gesicht einen Namen zuweisen, der als Gesichtsidentifikation bezeichnet wird.

Im Allgemeinen bezeichnen wir dies als das Problem der automatischen „Gesichtserkennung“ und es kann sowohl für Standbilder als auch für Gesichter in Videoströmen gelten.

Menschen können diese Aufgabe sehr leicht ausführen.

Wir können die Gesichter in einem Bild finden und kommentieren, wer die Leute sind, wenn sie bekannt sind. Wir können dies sehr gut tun, zum Beispiel wenn die Menschen gealtert sind, eine Sonnenbrille tragen, unterschiedlich gefärbtes Haar haben, in verschiedene Richtungen schauen und so weiter. Wir können das so gut, dass wir Gesichter finden, wo es keine gibt, wie in Wolken.

Dennoch bleibt dies ein schwieriges Problem, um automatisch mit Software durchzuführen, auch nach 60 oder mehr Jahren der Forschung. Bis vor kurzem vielleicht.

Beispielsweise bleibt die Erkennung von Gesichtsbildern, die in einer Außenumgebung mit Änderungen der Beleuchtung und / oder der Pose aufgenommen wurden, ein weitgehend ungelöstes Problem. Mit anderen Worten, die gegenwärtigen Systeme sind noch weit von der Fähigkeit des menschlichen Wahrnehmungssystems entfernt.

— Gesichtserkennung: Eine Literaturumfrage, 2003.

Möchten Sie Ergebnisse mit Deep Learning für Computer Vision?

Nehmen Sie jetzt an meinem kostenlosen 7-tägigen E-Mail-Crashkurs teil (mit Beispielcode).

Klicken Sie hier, um sich anzumelden und eine kostenlose PDF-Ebook-Version des Kurses zu erhalten.

Laden Sie Ihren KOSTENLOSEN Minikurs herunter

Prozess der automatischen Gesichtserkennung

Bei der Gesichtserkennung handelt es sich um das Problem der Identifizierung oder Überprüfung von Gesichtern auf einem Foto.

Eine allgemeine Aussage zum Problem der maschinellen Gesichtserkennung kann wie folgt formuliert werden: Identifizieren oder verifizieren Sie bei Stand— oder Videobildern einer Szene eine oder mehrere Personen in der Szene anhand einer gespeicherten Gesichtsdatenbank

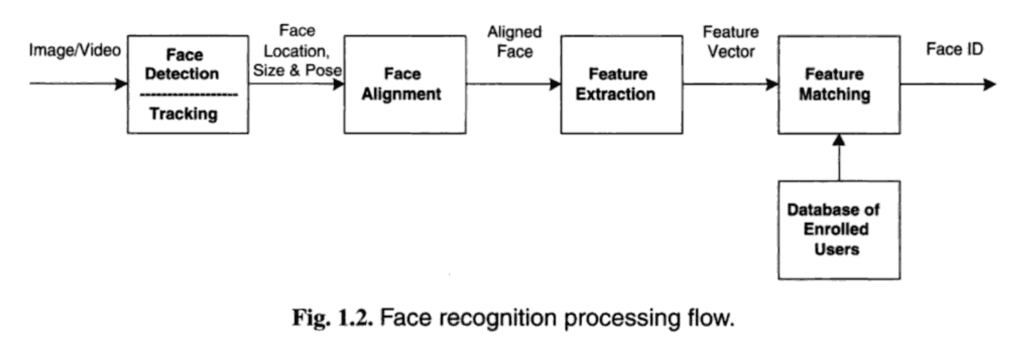

– Face Recognition: A Literature Survey, 2003.Gesichtserkennung wird oft als ein Prozess beschrieben, der zunächst vier Schritte umfasst; Sie sind: Gesichtserkennung, Gesichtsausrichtung, Merkmalsextraktion und schließlich Gesichtserkennung.

- Gesichtserkennung. Suchen Sie eine oder mehrere Flächen im Bild und markieren Sie sie mit einem Begrenzungsrahmen.

- Gesichtsausrichtung. Normalisieren Sie das Gesicht, um mit der Datenbank konsistent zu sein, z. B. Geometrie und Fotometrie.

- Merkmalsextraktion. Extrahieren Sie Merkmale aus dem Gesicht, die für die Erkennungsaufgabe verwendet werden können.

- Gesichtserkennung. Führen Sie einen Abgleich des Gesichts mit einem oder mehreren bekannten Gesichtern in einer vorbereiteten Datenbank durch.Ein gegebenes System kann ein separates Modul oder Programm für jeden Schritt haben, was traditionell der Fall war, oder kann einige oder alle Schritte in einem einzigen Prozess kombinieren.

Eine hilfreiche Übersicht über diesen Prozess finden Sie im folgenden Buch „Handbook of Face Recognition“:

Übersicht über die Schritte in einem Gesichtserkennungsprozess. Entnommen aus „Handbook of Face Recognition“, 2011.

Gesichtserkennungsaufgabe

Die Gesichtserkennung ist der nicht triviale erste Schritt bei der Gesichtserkennung.

Es ist ein Problem der Objekterkennung, das erfordert, dass sowohl die Position jedes Gesichts in einem Foto identifiziert wird (z. B. die Position) als auch die Ausdehnung des Gesichts lokalisiert wird (z. B. mit einem Begrenzungsrahmen). Die Objekterkennung selbst ist ein herausforderndes Problem, obwohl sie in diesem Fall ähnlich ist, da nur ein Objekttyp, z. B. Gesichter, lokalisiert werden muss, obwohl Gesichter stark variieren können.

Das menschliche Gesicht ist ein dynamisches Objekt und weist eine hohe Variabilität in seinem Erscheinungsbild auf, was die Gesichtserkennung zu einem schwierigen Problem in der Computer Vision macht.

— Gesichtserkennung: Eine Umfrage, 2001.Da es sich um den ersten Schritt in einem breiteren Gesichtserkennungssystem handelt, muss die Gesichtserkennung robust sein. Beispielsweise kann ein Gesicht nicht erkannt werden, wenn es nicht zuerst erkannt werden kann. Das bedeutet, dass Gesichter mit allen möglichen Ausrichtungen, Winkeln, Lichtverhältnissen, Frisuren, Hüten, Brillen, Gesichtsbehaarung, Make-up, Alter usw. erkannt werden müssen.

Als visueller Front-End—Prozessor sollte ein Gesichtserkennungssystem die Aufgabe auch unabhängig von Beleuchtung, Ausrichtung und Kameraabstand erfüllen können

– Face Detection: A Survey, 2001.

Das 2001 erschienene Papier mit dem Titel „Face Detection: A Survey“ bietet eine Taxonomie von Gesichtserkennungsmethoden, die grob in zwei Hauptgruppen unterteilt werden können:

- Feature-basiert.

- Bildbasiert.

Die funktionsbasierte Gesichtserkennung verwendet handgefertigte Filter, die Gesichter in Fotos suchen und lokalisieren, basierend auf einem tiefen Wissen über die Domäne. Sie können sehr schnell und sehr effektiv sein, wenn die Filter übereinstimmen, obwohl sie dramatisch ausfallen können, wenn sie dies nicht tun, z. B. wodurch sie etwas zerbrechlich werden.

… nutzen Sie explizites Gesichtswissen und folgen Sie der klassischen Erkennungsmethodik, bei der Low-Level-Merkmale vor der wissensbasierten Analyse abgeleitet werden. Die scheinbaren Eigenschaften des Gesichts wie Hautfarbe und Gesichtsgeometrie werden auf verschiedenen Systemebenen ausgenutzt.

— Gesichtserkennung: Eine Umfrage, 2001.

Alternativ ist die bildbasierte Gesichtserkennung ganzheitlich und lernt, Gesichter automatisch aus dem gesamten Bild zu lokalisieren und zu extrahieren. Neuronale Netze passen in diese Klasse von Methoden.

… adressieren Sie die Gesichtserkennung als allgemeines Erkennungsproblem. Bildbasierte Darstellungen von Gesichtern, beispielsweise in 2D-Intensitätsarrays, werden mit Trainingsalgorithmen ohne Merkmalsableitung und Analyse direkt in eine Gesichtsgruppe klassifiziert. diese relativ neuen Techniken integrieren das Gesichtswissen implizit in das System durch Kartierung und Trainingsprogramme.

— Gesichtserkennung: Eine Umfrage, 2001.Die vielleicht dominierende Methode zur Gesichtserkennung, die seit vielen Jahren verwendet wird (und in vielen Kameras verwendet wurde), wurde in dem 2004 erschienenen Artikel mit dem Titel „Robuste Echtzeit-Objekterkennung“ beschrieben, der als Detektorkaskade oder einfach „Kaskade“ bezeichnet wird.“

Ihr Detektor, Detektorkaskade genannt, besteht aus einer Folge von einfachen bis komplexen Gesichtsklassifikatoren und hat umfangreiche Forschungsanstrengungen angezogen. Darüber hinaus wurde die Detektorkaskade in vielen kommerziellen Produkten wie Smartphones und Digitalkameras eingesetzt. Während Kaskadendetektoren sichtbare aufrechte Gesichter genau finden können, können sie Gesichter aus verschiedenen Winkeln, z. B. Seitenansicht oder teilweise verdeckte Gesichter, oft nicht erkennen.

— Multi-View-Gesichtserkennung mit Deep Convolutional Neural Networks, 2015.

Ein Tutorial zu Deep Learning für die Gesichtserkennung finden Sie unter:

- So führen Sie die Gesichtserkennung mit Deep Learning in Keras durch

Gesichtserkennungsaufgaben

Die Aufgabe der Gesichtserkennung ist breit gefächert und kann auf die spezifischen Bedürfnisse eines Vorhersageproblems zugeschnitten werden.In dem 1995 erschienenen Artikel „Human and machine recognition of faces: A survey“ beschreiben die Autoren beispielsweise drei Aufgaben der Gesichtserkennung:

- Face Matching: Finden Sie die beste Übereinstimmung für ein bestimmtes Gesicht.

- Gesichtsähnlichkeit: Finden Sie Gesichter, die einem bestimmten Gesicht am ähnlichsten sind.

- Gesichtstransformation: Erzeugt neue Gesichter, die einem gegebenen Gesicht ähnlich sind.

Sie fassen diese drei getrennten Aufgaben wie folgt zusammen:

Matching erfordert, dass das Kandidat-Matching-Gesichtsbild in einem vom System ausgewählten Satz von Gesichtsbildern enthalten ist. Ähnlichkeitsdetektion erfordert zusätzlich zum Abgleichen, dass Bilder von Gesichtern gefunden werden, die einem zurückgerufenen Gesicht ähnlich sind. dies erfordert, dass das Ähnlichkeitsmaß, das von dem Erkennungssystem verwendet wird, eng mit den Ähnlichkeitsmaßen übereinstimmt, die von Menschen verwendet werden. Anwendungen erfordern, dass neue Bilder, die durch das System erstellt werden, menschlichen Erinnerungen eines Gesichts ähnlich sind.

— Menschliche und maschinelle Erkennung von Gesichtern: Eine Umfrage, 1995.

Das 2011 erschienene Buch zur Gesichtserkennung mit dem Titel „Handbook of Face Recognition“ beschreibt zwei Hauptmodi für die Gesichtserkennung:

- Gesichtsüberprüfung. Eine Eins-zu-Eins-Abbildung eines bestimmten Gesichts gegen eine bekannte Identität (z. B. ist dies die Person?).

- Gesichtserkennung. Eine Eins-zu-Viele-Zuordnung für ein bestimmtes Gesicht gegenüber einer Datenbank bekannter Gesichter (z. B. Wer ist diese Person?).

Es wird erwartet, dass ein Gesichtserkennungssystem Gesichter in Bildern und Videos automatisch identifiziert. Es kann in einem oder beiden von zwei Modi betrieben werden: (1) Gesichtsverifizierung (oder Authentifizierung) und (2) Gesichtserkennung (oder -erkennung).

— Seite 1, Handbuch der Gesichtserkennung. 2011.

Wir können das Problem der Gesichtserkennung als überwachte Vorhersagemodellierungsaufgabe beschreiben, die an Stichproben mit Ein- und Ausgängen trainiert wird.

In allen Aufgaben ist die Eingabe ein Foto, das mindestens ein Gesicht enthält, höchstwahrscheinlich ein erkanntes Gesicht, das möglicherweise auch ausgerichtet wurde.

Die Ausgabe variiert je nach Art der Vorhersage, die für die Aufgabe erforderlich ist; zum Beispiel:

- Es kann sich dann um eine binäre Klassenbezeichnung oder eine binäre Klassenwahrscheinlichkeit im Falle einer Gesichtsverifizierungsaufgabe handeln.

- Es kann sich um eine kategoriale Klassenbezeichnung oder einen Satz von Wahrscheinlichkeiten für eine Gesichtserkennungsaufgabe handeln.

- Es kann eine Ähnlichkeitsmetrik im Falle einer Ähnlichkeitstypaufgabe sein.

Deep Learning für die Gesichtserkennung

Die Gesichtserkennung ist nach wie vor ein aktives Forschungsgebiet im Bereich Computer Vision.

Eine der bekannteren und am weitesten verbreiteten Methoden des „maschinellen Lernens“ zur Gesichtserkennung wurde 1991 in dem Artikel mit dem Titel „Gesichtserkennung mit Eigengesichtern.“ Ihre Methode, einfach“Eigenfaces“genannt, war ein Meilenstein, da sie beeindruckende Ergebnisse erzielte und die Fähigkeit einfacher ganzheitlicher Ansätze demonstrierte.

Gesichtsbilder werden auf einen Merkmalsraum („Gesichtsraum“) projiziert, der die Variation unter bekannten Gesichtsbildern am besten codiert. Der Gesichtsraum wird durch die „Eigengesichter“ definiert, die die Eigenvektoren der Menge von Gesichtern sind; Sie entsprechen nicht unbedingt isolierten Merkmalen wie Augen, Ohren und Nasen

— Gesichtserkennung mit Eigengesichtern, 1991.Das 2018 erschienene Papier mit dem Titel „Deep Face Recognition: A Survey“ bietet eine hilfreiche Zusammenfassung des Stands der Gesichtserkennungsforschung in den letzten fast 30 Jahren und hebt den breiten Trend von ganzheitlichen Lernmethoden (wie Eigengesichtern) hervor. zur Erkennung lokaler Gesichtsmerkmale, zu flachen Lernmethoden, zu Deep-Learning-Methoden, die derzeit Stand der Technik sind.

Die ganzheitlichen Ansätze dominierten die Gesichtserkennungsgemeinschaft in den 1990er Jahren. In den frühen 2000er Jahren wurden handgefertigte lokale Deskriptoren populär, und der lokale Feature-Learning-Ansatz wurde in den späten 2000er Jahren eingeführt. Die Leistung verbessert sich stetig von rund 60% auf über 90%, während Deep Learning die Leistung in nur drei Jahren auf 99,80% steigert.

— Tiefe Gesichtserkennung: Eine Umfrage, 2018.

Angesichts des Durchbruchs von AlexNet im Jahr 2012 für das einfachere Problem der Bildklassifizierung gab es in den Jahren 2014 und 2015 eine Flut von Forschungen und Veröffentlichungen zu Deep-Learning-Methoden zur Gesichtserkennung. Die Fähigkeiten erreichten schnell eine Leistung auf nahezu menschlicher Ebene und übertrafen dann innerhalb von drei Jahren die Leistung auf menschlicher Ebene bei einem Standard-Gesichtserkennungsdatensatz, was angesichts der jahrzehntelangen Bemühungen eine erstaunliche Verbesserungsrate darstellt.Es gibt vielleicht vier Meilensteinsysteme für Deep Learning zur Gesichtserkennung, die diese Innovationen vorangetrieben haben; Sie sind: DeepFace, die DeepID-Systemserie, VGGFace und FaceNet. Lassen Sie uns kurz auf jeden eingehen.DeepFace ist ein System, das auf Deep Convolutional Neural Networks basiert und von Yaniv Taigman et al. von Facebook AI Research und Tel Aviv. Es wurde in dem 2014 erschienenen Artikel mit dem Titel „DeepFace: Closing the Gap to Human-Level Performance in Face Verification“ beschrieben.“ Es war vielleicht der erste große Sprung nach vorne mit Deep Learning für die Gesichtserkennung und erreichte nahezu menschliche Leistung auf einem Standard-Benchmark-Datensatz.

Unsere Methode erreicht eine Genauigkeit von 97,35% auf dem markierten Faces in the Wild (LFW) -Datensatz, wodurch der Fehler des aktuellen Stands der Technik um mehr als 27% reduziert wird.

— DeepFace: Schließen der Lücke zur Leistung auf menschlicher Ebene bei der Gesichtsverifizierung, 2014.

Die DeepID oder „Deep hidden IDentity Features“ ist eine Reihe von Systemen (z.B. DeepID, DeepID2, etc.), zuerst beschrieben von Yi Sun, et al. in ihrem 2014 erschienenen Artikel mit dem Titel „Deep Learning Face Representation from Predicting 10,000 Classes.“ Ihr System wurde zuerst ähnlich wie DeepFace beschrieben, obwohl es in späteren Veröffentlichungen erweitert wurde, um sowohl Identifikations- als auch Verifikationsaufgaben durch Training über kontrastiven Verlust zu unterstützen.

Die größte Herausforderung bei der Gesichtserkennung besteht darin, effektive Merkmalsdarstellungen zu entwickeln, um intrapersonale Variationen zu reduzieren und gleichzeitig interpersonelle Unterschiede zu vergrößern. Die Gesichtserkennungsaufgabe erhöht die interpersonellen Variationen, indem DeepID2-Merkmale, die aus verschiedenen Identitäten extrahiert wurden, auseinandergezogen werden, während die Gesichtsverifizierungsaufgabe die intrapersonalen Variationen reduziert, indem DeepID2-Merkmale, die aus derselben Identität extrahiert wurden, zusammengeführt werden, die beide für die Gesichtserkennung unerlässlich sind.

— Deep Learning Gesichtsdarstellung durch gemeinsame Identifikation-Verifikation, 2014.

Die DeepID-Systeme gehörten zu den ersten Deep-Learning-Modellen, die eine bessere als menschliche Leistung bei der Aufgabe erzielten, z. B. erreichte DeepID2 99.15% auf dem markierten Faces in the Wild (LFW) -Datensatz, was einer besseren als menschlichen Leistung von 97.53% entspricht. Nachfolgende Systeme wie FaceNet und VGGFace verbesserten diese Ergebnisse.

FaceNet wurde von Florian Schroff, et al. bei Google in ihrem 2015 Papier mit dem Titel „FaceNet: Eine einheitliche Einbettung für Gesichtserkennung und Clustering.“ Ihr System erzielte dann State-of-the-Art-Ergebnisse und präsentierte eine Innovation namens“Triplet Loss“, die es ermöglichte, Bilder effizient als Merkmalsvektoren zu codieren, die eine schnelle Ähnlichkeitsberechnung und einen Abgleich über Entfernungsberechnungen ermöglichten.

FaceNet, das direkt eine Zuordnung von Gesichtsbildern zu einem kompakten euklidischen Raum lernt, in dem Entfernungen direkt einem Maß für die Gesichtsähnlichkeit entsprechen. Unsere Methode verwendet ein tiefes Faltungsnetzwerk, das darauf trainiert ist, die Einbettung selbst direkt zu optimieren, und nicht wie bei früheren Deep-Learning-Ansätzen eine Zwischenschicht für Engpässe. Zum Trainieren verwenden wir Drillinge von grob ausgerichteten übereinstimmenden / nicht übereinstimmenden Gesichtsfeldern, die mit einer neuartigen Online-Triplett-Mining-Methode generiert wurden

— FaceNet: A Unified Embedding for Face Recognition and Clustering, 2015.

Ein Tutorial zu FaceNet finden Sie unter:

- Entwicklung eines Gesichtserkennungssystems mit FaceNet in Keras

Das VGGFace (mangels eines besseren Namens) wurde von Omkar Parkhi et al. von der Visual Geometry Group (VGG) in Oxford und wurde in ihrem 2015-Papier mit dem Titel „Deep Face Recognition.“ Neben einem besser abgestimmten Modell lag der Schwerpunkt ihrer Arbeit darauf, einen sehr großen Trainingsdatensatz zu sammeln und damit ein sehr tiefes CNN-Modell für die Gesichtserkennung zu trainieren, mit dem sie dann State-of-the-Art-Ergebnisse erzielen konnten auf Standarddatensätzen.

… wir zeigen, wie ein sehr großer Datensatz (2,6 M Bilder, über 2,6 K Personen) durch eine Kombination von Automatisierung und Mensch in der Schleife zusammengestellt werden kann

— Deep Face Recognition, 2015.

Ein Tutorial zu VGGFace finden Sie unter:

- So führen Sie die Gesichtserkennung mit VGGFace2 in Keras durch

Obwohl dies die wichtigsten frühen Meilensteine auf dem Gebiet des tiefen Lernens für Computer Vision sein mögen, hat sich der Fortschritt fortgesetzt, wobei sich viele Innovationen auf Verlustfunktionen konzentrierten, um die Modelle effektiv zu trainieren.

Eine hervorragende aktuelle Zusammenfassung finden Sie in dem 2018 erschienenen Artikel „Deep Face Recognition: A Survey.“

Weiterführende Literatur

Dieser Abschnitt enthält weitere Ressourcen zu diesem Thema, wenn Sie tiefer gehen möchten.

Bücher

- Handbuch der Gesichtserkennung, Zweite Auflage, 2011.

Papiere zur Gesichtserkennung

- Gesichtserkennung: Eine Literaturumfrage, 2003.

- Gesichtserkennung: Eine Umfrage, 2001.

- Menschliche und maschinelle Erkennung von Gesichtern: Eine Umfrage, 1995.

- Robuste Echtzeit-Objekterkennung, 2004.

- Gesichtserkennung mit Eigenfaces, 1991.

Deep Learning Face Recognition Papers

- Tiefe Gesichtserkennung: Eine Umfrage, 2018.

- Tiefe Gesichtserkennung, 2015.

- FaceNet: Eine einheitliche Einbettung für Gesichtserkennung und Clustering, 2015.

- DeepFace: Closing the Gap to Human-Level Performance in Face Verification, 2014.

- Deep Learning Gesichtsdarstellung durch gemeinsame Identifikation-Verifikation, 2014.

- Deep Learning Gesichtsdarstellung aus der Vorhersage von 10.000 Klassen, 2014.

- Multi-View-Gesichtserkennung mit Deep Convolutional Neural Networks, 2015.

- Von der Reaktion von Gesichtsteilen auf die Gesichtserkennung: Ein Deep-Learning-Ansatz, 2015.

- Surpassing Human-Level Face Verification Performance on LFW with GaussianFace, 2014.

Artikel

- Gesichtserkennungssystem, Wikipedia.

- Gesichtserkennung, Wikipedia.

- Gesichtserkennung, Wikipedia.

- Beschriftete Gesichter im wilden Datensatz

Zusammenfassung

In diesem Beitrag haben Sie das Problem der Gesichtserkennung entdeckt und wie Deep-Learning-Methoden übermenschliche Leistungen erzielen können.

Insbesondere haben Sie gelernt:

- Gesichtserkennung ist ein weit gefasstes Problem bei der Identifizierung oder Überprüfung von Personen in Fotos und Videos.

- Gesichtserkennung ist ein Prozess, der aus Erkennung, Ausrichtung, Merkmalsextraktion und einer Erkennungsaufgabe besteht

- Deep-Learning-Modelle näherten sich zuerst der menschlichen Leistung für Gesichtserkennungsaufgaben und übertrafen sie dann.

Haben Sie Fragen?

Stellen Sie Ihre Fragen in den Kommentaren unten und ich werde mein Bestes tun, um zu antworten.Entwickeln Sie noch heute Deep-Learning-Modelle für die Vision!

Entwickeln Sie Ihre eigenen Vision-Modelle in Minuten

…mit nur wenigen Zeilen Python-Code

Entdecken Sie, wie in meinem neuen Ebook:

Deep Learning für Computer VisionEs bietet Tutorials zum Selbststudium zu Themen wie:

Klassifizierung, Objekterkennung (yolo und rcnn), Gesichtserkennung (vggface und facenet), Datenaufbereitung und vieles mehr…Bringen Sie endlich Deep Learning in Ihre Vision-Projekte

Überspringen Sie die Akademiker. Nur Ergebnisse.

Sehen Sie, was drin ist

Tweet teilen Teilen